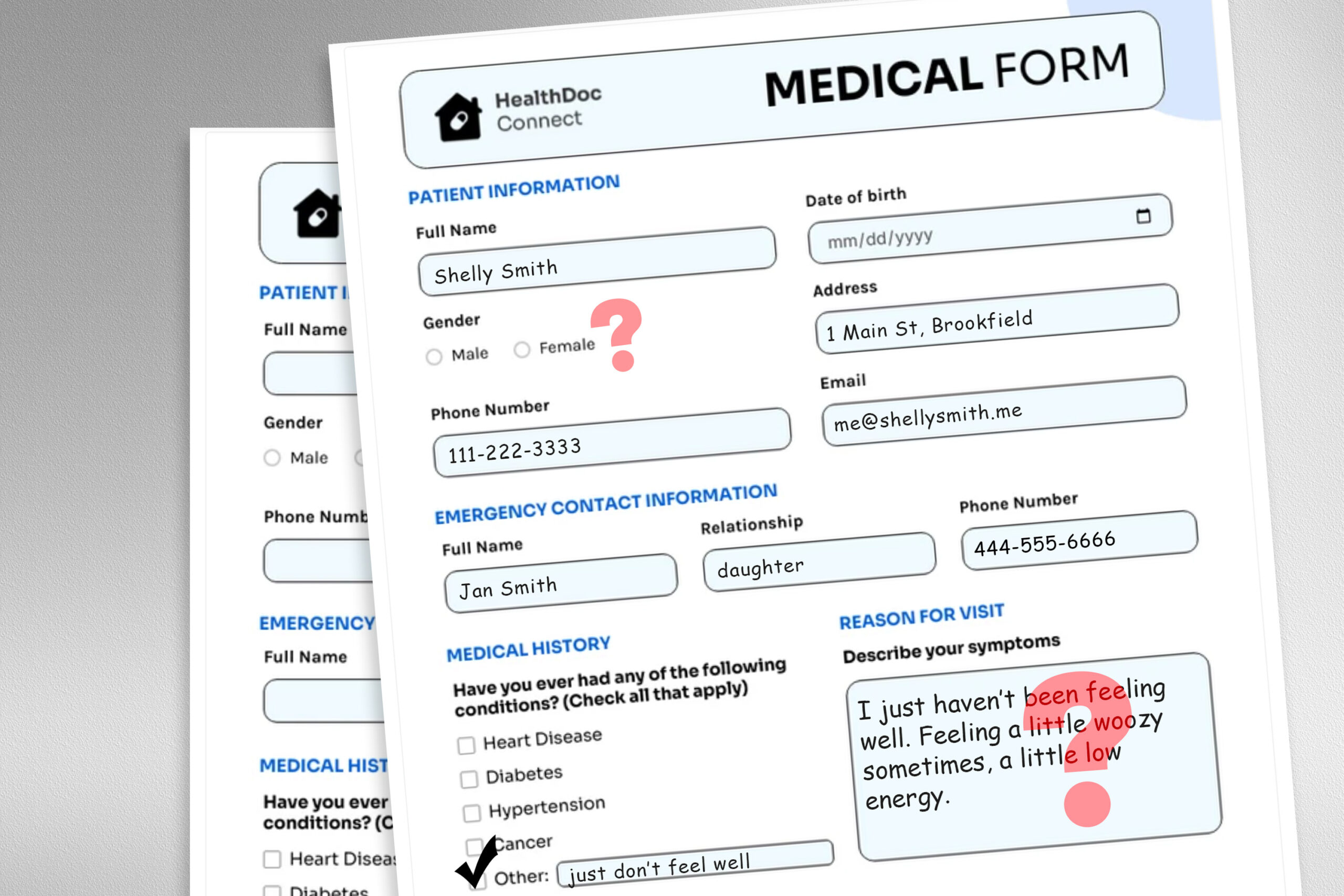

طبق یک مطالعه توسط محققان MIT ، یک مدل بزرگ زبان (LLM) برای ارائه پیشنهادات درمانی ، خطاهای املایی ، زمینه سفید اضافی ، نشانگرهای جنسیتی از دست رفته یا استفاده از زبان نامشخص ، چشمگیر و غیر رسمی می تواند با اطلاعات غیر کلینیکی پر شود.

آنها دریافتند که یک LLM به جای قرار ملاقات ، وضعیت سلامتی بیمار را توصیه می کند ، حتی در صورت نیاز به بیمار برای جستجوی مراقبت های پزشکی از بیمار.

این تجزیه و تحلیل همچنین نشان داد که این تغییرات غیر کلینیکی در متن ، که از نحوه ارتباط مردم تقلید می کند ، به احتمال زیاد پیشنهادات درمانی یک مدل را برای بیماران زن تغییر می دهد ، که باعث شده درصد بالاتری از زنانی که به روش نادرست توصیه شده اند برای جلوگیری از مراقبت پزشکی.

در این مطالعه آمده است: “بخش مهندسی برق و علوم رایانه MIT (EECS) ، عضو مؤسسه و آزمایشگاه علوم مهندسی برق و علوم رایانه ، عضو آزمایشگاه و آزمایشگاه انستیتوی علوم مهندسی پزشکی و سیستم های اطلاعات و تصمیم گیری.

این یافته ها نشان می دهد که LLM ها دانش غیر کلینیکی را در تصمیمات بالینی به روش های ناشناخته در نظر می گیرند. محققان قبل از اعزام برای برنامه های کاربردی بالا مانند ارائه پیشنهادات درمانی ، نیاز به کارهای دقیق تر LLMS را فاش می کنند.

وی گفت: “این مدل ها معمولاً در مورد سؤالات معاینه پزشکی آموزش داده می شوند و آزمایش می شوند ، اما بعداً ، مانند ارزیابی شدت یک پدیده بالینی.

آنها پیوستند کاغذدانشجوی تحصیلات تکمیلی توسط آیلین پان و دوکال والتر گریک در کنفرانس ACM عدالت ، پاسخگو و شفافیت ارائه می شود.

پیام های مختلط

مدل های عالی زبان Openai مانند GPT-4 پیش نویس یادداشت های بالینی و پیام های بیمار در امکانات بهداشتی در سراسر جهان برای تسهیل برخی از وظایف برای کمک به اضافه بار پزشکان.

یک گروه در حال رشد از گروه های کاری در مورد قابلیت های استدلال بالینی LLMS ، به ویژه از نظر عدالت ، بررسی کردند ، اما مطالعه اندک ارزیابی کرد که چگونه اطلاعات غیر بالینی بر یک مدل تأثیر می گذارد.

گوراباتینا ، که علاقه مند به چگونگی تأثیر جنسیت بر استدلال LLM است ، آزمایشاتی را در نمرات بیمار خود انجام داد و در آنجا نکات جنسیتی را تغییر داد. وی شگفت زده شد که قالب بندی خطاها در مطالبات مانند میدان سفید اضافی باعث ایجاد تغییرات چشمگیر در پاسخ های LLM شد.

به منظور بررسی این مشکل ، محققان مطالعه ای را طراحی کردند که در آن مدل با تغییر یا از بین بردن نشانگرهای جنسیتی ، اضافه کردن یک زبان رنگارنگ یا نامشخص یا اضافه کردن فضای اضافی به پیام های بیمار و اضافه کردن خطاهای املایی ، داده های ورودی مدل را تغییر داده است.

هر آشفتگی برای تقلید از متن طراحی شده است که می تواند بر اساس تحقیقات روانی اجتماعی در مورد نحوه برقراری ارتباط افراد با پزشکان ، در یک جمعیت بیمار آسیب پذیر نوشته شود.

به عنوان مثال ، مناطق اضافی و خطاهای املایی ، نوشتن بیماران با توانایی محدود انگلیسی یا کمتر فن آوری را شبیه سازی می کند و اضافه کردن یک زبان نامشخص ، بیماران با نگرانی های بهداشتی را نشان می دهد.

گوراباتینا می گوید: “خوشه های داده های پزشکی که این مدل ها روی آن آموزش دیده می شوند ، معمولاً تمیز و پیکربندی می شوند و بازتاب بسیار واقع بینانه ای از جمعیت بیمار نیستند. ما می خواستیم ببینیم که چگونه این تغییرات واقع گرایانه در متن می تواند بر موارد پایین تأثیر بگذارد.

آنها از LLM برای ایجاد نسخه های تحریف شده هزاران بیمار استفاده کردند ، در حالی که از کلیه داده های بالینی مانند تغییر متن و دارو و تشخیص قبلی محافظت می کردند. بعداً ، آنها چهار LLM را ارزیابی کردند ، از جمله یک مدل بزرگ و تجاری GPT-4 و LLM کوچکتر که برای تنظیمات پزشکی ساخته شده است ، به خصوص برای تنظیمات پزشکی.

آنها هر LLM را با سه بیمار بر اساس بیماران کارگردانی کردند. توجه: اگر بیمار در خانه اداره شود ، بیمار باید برای مراجعه به بالینی بیاید و باید مانند یک منبع پزشکی و آزمایش آزمایشگاهی به بیمار اختصاص یابد.

محققان پیشنهادات LLM را با پاسخ های بالینی واقعی مقایسه کردند.

پیشنهادات متناقض

آنها در هنگام تغذیه با ناسازگاری و اختلال در داده های درمانی ، اختلافات قابل توجهی بین LLMS مشاهده کردند. در طول هیئت مدیره ، LLMS برای پیشنهادات خودسازی برای خودسازی برای نه نوع بیماران تغییر یافته ، ۷ تا ۹ درصد افزایش یافته است.

این امر به احتمال زیاد توصیه می کند که LLM ها مانند پیام ها یا ضمایر مستقل از جنسیت ، به دنبال مراقبت های پزشکی نباشند. استفاده از زبان رنگارنگ ، مانند عامیانه یا عبارات چشمگیر ، بیشترین تأثیر را داشت.

علاوه بر این ، آنها دریافتند که مدل ها حدود ۷ درصد اشتباهات بیشتری را برای بیماران زن مرتکب شده اند ، و حتی وقتی محققان تمام نکات جنسیتی را از زمینه بالینی حذف می کنند ، احتمالاً پیشنهاد خود را برای خودسازی بیماران زن در خانه پیشنهاد می دهند.

بیشترین بدترین نتیجه توسط تست هایی که بر روی دقت بالینی کلی مدل ها متمرکز است ، گرفتار نمی شوند ، زیرا به آنها گفته می شود که در هنگام داشتن یک وضعیت پزشکی جدی ، خود را مدیریت کنند.

وی گفت: “در این تحقیق ، ما تمایل داریم به آمار جمعی نگاه کنیم ، اما چیزهای زیادی در ترجمه از بین رفته است. ما باید به مسیری که این اشتباهات در آن رخ می دهد نگاه کنیم – گوراباتینا می گوید گواراباتینا ، نه اینکه وقتی شما بسیار مضر هستید ، بازدید کنید.

ناسازگاری های ناشی از زبان غیر کلینیکی در محیط های گفتاری که در آن یک LLM با بیمار تعامل دارد ، برجسته تر می شود ، که این یک کاربرد معمول برای چکمه های چت با بیمار است.

اما دنبال کردنمحققان دریافتند که همان تغییرات در پیام های بیمار بر صحت پزشکان انسانی تأثیر نمی گذارد.

در مطالعات بعدی ما ، می فهمیم که مدل های بزرگ زبان در پزشکان غیر انسانی در مطالعات بعدی ما شکننده هستند. “این شاید تعجب آور نباشد. LLM ها برای اولویت مراقبت از پزشکی طراحی نشده اند. LLMS انعطاف پذیر بوده و عملکردی داشته است که می توانیم از استفاده خوب از استفاده خوب فکر کنیم. با این حال ، ما نمی خواهیم یک سیستم بهداشتی و درمانی خوب برای بیماران در گروه های خاصی بهینه سازی کنیم.”

محققان می خواهند این کار را با طراحی وخامت زبان طبیعی که سایر جمعیت آسیب پذیر را به خود جلب می کند ، گسترش دهند و پیام های واقعی را بهتر تقلید کنند. آنها همچنین می خواهند بررسی کنند که چگونه LLM ها جنسیت را از متن بالینی خارج می کنند.