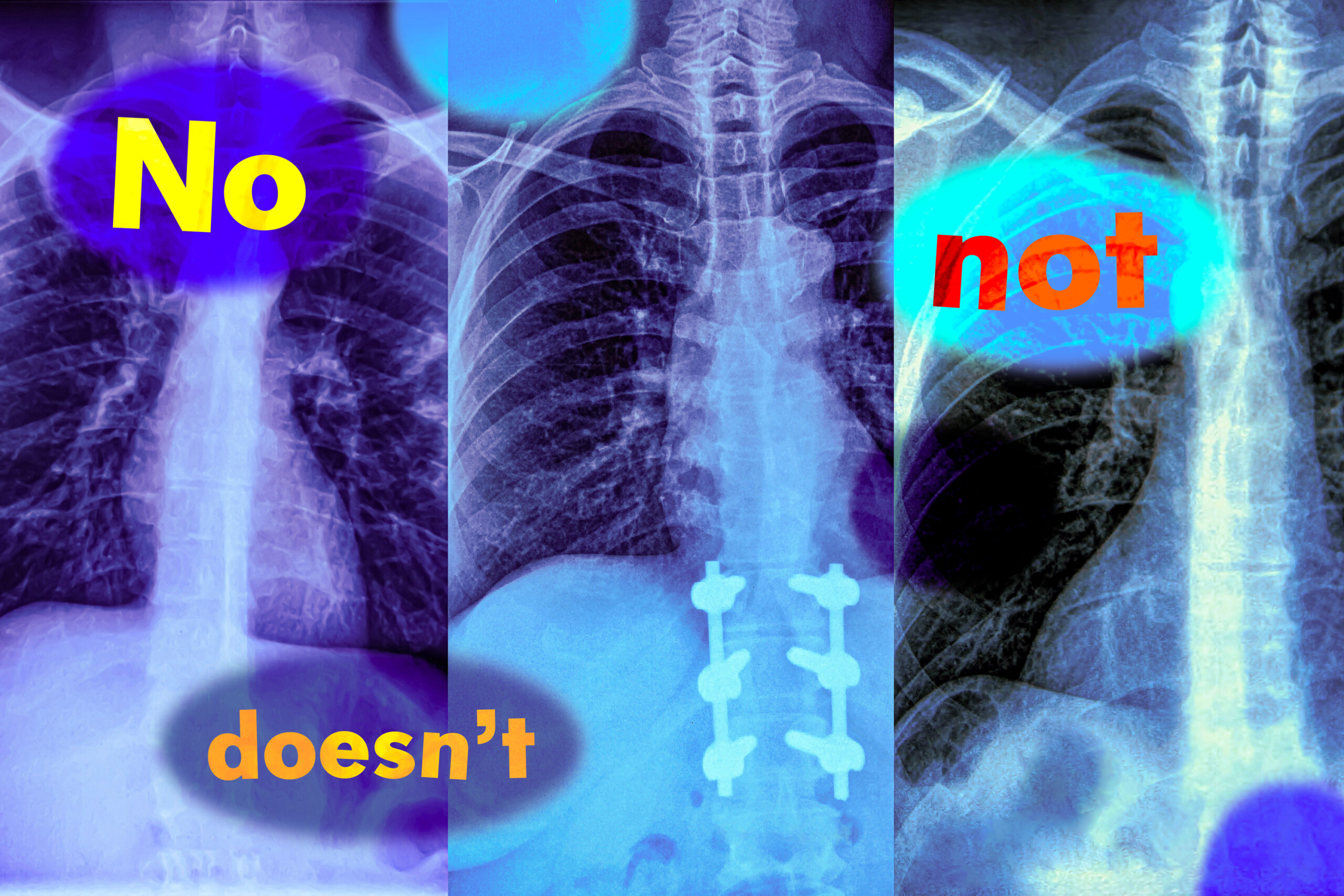

یک رادیولوژیست را از یک بیمار جدید تصور کنید که یک پستان X را بررسی می کند. او می فهمد که بیمار در بافت متورم است اما قلب گسترده ای ندارد. یک زبان بصری می تواند از یک مدل یادگیری ماشین استفاده کند تا به دنبال گزارش هایی از بیماران مشابه باشد که می خواهند تشخیص را تسریع کنند.

با این حال ، اگر این مدل به طور تصادفی گزارش ها را در هر دو مورد تعریف کند ، محتمل ترین تشخیص ممکن است کاملاً متفاوت باشد: اگر بیمار تورم بافت و قلب بزرگ شده داشته باشد ، احتمالاً این بیماری در ارتباط با قلبی است ، اما ممکن است بدون وجود قلب بزرگ ایجاد شود.

در یک مطالعه جدید ، محققان MIT دریافتند که مدل های زبان بینایی احتمالاً در موقعیت های دنیای واقعی چنین اشتباهی را انجام می دهند ، زیرا آنها کلمات نفی مانند “نه” و “نه” را که ناپدید می شوند درک نمی کنند.

وی گفت: “این کلمات نفی ممکن است تأثیر بسیار مهمی داشته باشند ، و اگر کورکورانه از این مدل ها استفاده کنیم ، ممکن است با نتایج فاجعه روبرو شویم ، kum این مطالعهبشر

محققان توانایی مدل های زبان بصری را برای تعریف نفی زیرنویس تصویر آزمایش کردند. مدل ها معمولاً و همچنین یک پیش بینی تصادفی ساخته می شدند. بر اساس این یافته ها ، تیم یک مجموعه داده تصویر را با زیرنویس های مربوطه حاوی کلمات تعریف شده اشیاء گمشده ایجاد کرد.

هنگامی که یک مدل برای دریافت تصاویری که حاوی اشیاء خاص نیستند ، نشان می دهد که بازسازی یک مدل زبان بینایی با این مجموعه داده منجر به پیشرفت عملکرد می شود. همچنین دقت سؤالات چند گزینه ای را که با زیرنویس منفی پاسخ می دهند ، افزایش می دهد.

با این حال ، محققان به نیاز به کار بیشتر برای رفع دلایل اصلی این مشکل توجه می کنند. کاربران بالقوه تحقیقات خود امیدوارند که این مدلها با کمبودی که ممکن است در محیط های با فشار زیاد که در حال حاضر در آن مورد استفاده قرار می گیرند ، تأثیرات جدی داشته باشد ، از تعیین اینکه بیماران درمانی خاص را برای شناسایی نقایص محصول در تأسیسات تولیدی دریافت می کنند ، سازگار شوند.

وی گفت: “این یک مقاله فنی است ، اما مشکلات بیشتری برای در نظر گرفتن وجود دارد.

غاسمی و الامود به مقاله Shaden Alshammer ، دانشجوی فارغ التحصیل MIT پیوستند. Openai Yonglong Tian ؛ Guohao Li ، یک پزشک قدیمی در دانشگاه آکسفورد ؛ پروفسور فیلیپ HS تور در آکسفورد ؛ و یون کیم ، عضو آزمایشگاه علوم کامپیوتر و اطلاعات مصنوعی (CSAIL) در استادیار دانشیار EECS و MIT. این تحقیق در یک کنفرانس تشخیص رایانه و الگوی ارائه می شود.

غفلت از غفلت

مدل های زبان بینایی (VLM) با استفاده از تصویر بزرگ و زیرنویس های مربوطه که آنها یاد گرفته اند به عنوان مجموعه شماره هایی که بازنمایی بردار به نام آنها را یاد می گیرند ، آموزش داده می شوند. مدل ها از این بردارها برای تمایز تصاویر مختلف استفاده می کنند.

یکی از VLM از دو رمزگذار جداگانه ، یکی برای متن و دیگری برای تصاویر استفاده می کند ، و رمزگذارها یاد می گیرند بردارهای مشابه را برای یک تصویر و عنوان متن مربوطه حذف کنند.

Grassemi آنچه را که در تصاویر اتفاق می افتد بیان می کند – یک برچسب مثبت. و در واقع ، این کل مشکل است.

از آنجا که خوشه های داده عنوان تصویر حاوی نمونه های منفی نیستند ، VLM ها هرگز یاد نمی گیرند که تعریف کنند.

به منظور حفر عمیق تر این مشکل ، محققان دو وظیفه معیار را طراحی کرده اند که توانایی VLMS را در درک نفی آزمایش کرده است.

اول ، آنها از یک مدل بزرگ زبان (LLM) برای راه اندازی مجدد تصاویر در یک داده موجود با درخواست از آنها استفاده کردند تا در مورد اشیاء مربوطه که در یک تصویر نبودند فکر کنند و بنویسند. بعداً ، آنها مدل ها را با کلمات منفی آزمایش کردند تا تصاویر حاوی اشیاء خاصی را بدست آورند ، اما نه دیگران.

برای کار دوم ، آنها سوالات چند گزینه ای را از VLM طراحی کردند تا مناسب ترین زیرنویس را از لیست گزینه ها انتخاب کنند. این زیرنویس ها فقط با افزودن مرجع به یک شیء که در تصویر ظاهر نمی شود یا رد شیئی که در تصویر ظاهر می شود ، متفاوت است.

مدل ها اغلب هر دو کار را شکست می دادند و عملکرد دریافت کننده تصویر با زیرنویس منفی حدود ۲۵ درصد کاهش می یابد. وقتی صحبت از سؤالات چند گزینه ای می شود ، بهترین مدل ها فقط ۳۹ درصد دقت را بدست آوردند ، و چندین مدل که تحت شانس تصادفی یا حتی شانس تصادفی انجام می شوند.

یکی از دلایل این شکست ، میانبر است که محققان آن را تعصب تأیید می نامند – VLMS کلمات منفی را نادیده می گیرد و روی اشیاء موجود در تصاویر متمرکز می شود.

اللامود می گوید: “این فقط برای کلماتی مانند” نه “و” نه “نیست. مهم نیست که چگونه منفی یا محرومیت را ابراز می کنید ، مدل ها آن را نادیده می گیرند.

این در هر VLM که آزمایش کرده بودند سازگار بود.

“یک مشکل حل شده”

از آنجا که VLM ها به طور معمول با منفی بودن در زیرنویس های تصویر آموزش دیده نبودند ، محققان خوشه های داده را با کلمات منفی به عنوان اولین قدم برای حل مشکل توسعه دادند.

آنها با استفاده از یک خوشه داده با یک زیرنویس متن ۱۰ میلیون تصویر ، آنها از زیرنویس های مربوط به LLM به استثنای تصاویر و ارائه زیرنویس های جدید با کلمات منفی خواستند.

هنگامی که این زیرنویس های مصنوعی هنوز به طور طبیعی خوانده شده یا با زیرنویس های پیچیده تری که توسط انسان نوشته شده است ، می تواند VLM در دنیای واقعی شکست بخورد.

با خوشه های داده ، آنها دریافتند که VLM های FinetUning منجر به افزایش عملکرد در صفحه می شوند. در حالی که در حال توسعه مدل های مدل تقریباً ۱۰ درصد است ، عملکرد سؤالات چند گزینه ای را تقریباً ۳۰ درصد افزایش داد.

آل اللامود می گوید: “اما راه حل ما کامل نیست. فقط خوشه های داده ، نوعی بزرگ شدن داده ها. ما حتی نحوه عملکرد این مدل ها را لمس نکردیم ، اما امیدواریم که این یک مشکل حل شده باشد و دیگران بتوانند راه حل ما را بهبود بخشند.

در عین حال ، وی امیدوار است که کار وی کاربران بیشتری را ترغیب کند تا از VLM برای استفاده از VLM برای حل و طراحی نمونه هایی برای آزمایش قبل از استقرار استفاده کنند.

در آینده ، محققان می توانند این کار را با آموزش VLM ها برای پردازش متون و تصاویر به طور جداگانه گسترش دهند ، که می تواند توانایی آنها در درک نفی را بهبود بخشد. آنها همچنین می توانند خوشه های داده اضافی حاوی تصاویر را برای برنامه های خاص مانند خدمات درمانی ایجاد کنند.